核心概念对比

| 特性 | Python | JavaScript (Node.js) |

|---|---|---|

| 生态系统 | 极其成熟和强大,拥有 requests, Scrapy, BeautifulSoup, Selenium, Playwright 等大量久经考验的库。 |

非常活跃且现代化,拥有 puppeteer, playwright, axios, cheerio, jsdom 等库,尤其是在自动化浏览器操作方面非常强大。 |

| 学习曲线 | 相对平缓,语法简洁清晰,对初学者非常友好,异步处理(asyncio)稍复杂,但基础部分很容易上手。 |

对前端开发者友好,如果你已经熟悉 JS,那么无缝衔接,异步编程 (async/await) 是 JS 的核心,天生适合处理网络 I/O。 |

| 性能 | CPU 密集型任务:由于 GIL(全局解释器锁),多线程在 CPU 密集型任务上表现不佳,但多进程可以解决。I/O 密集型任务:使用 asyncio 可以实现极高的并发。 |

I/O 密集型任务:Node.js 的单线程、事件驱动模型在处理大量并发网络请求时表现出色,性能非常高,CPU 密集型任务是其短板。 |

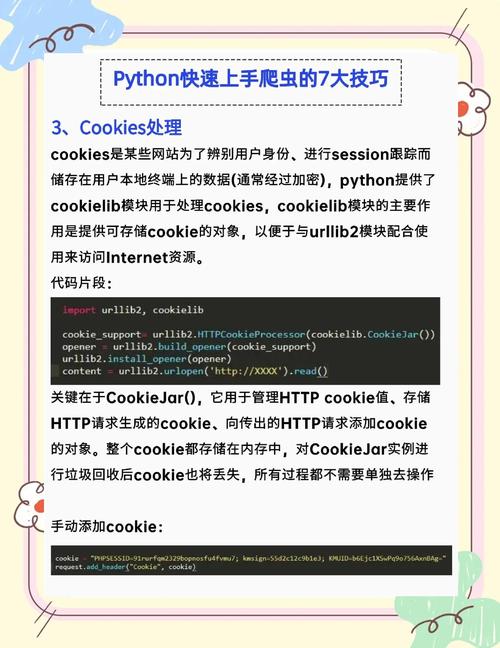

| 反爬虫应对 | 非常灵活。Scrapy 框架内置了代理轮换、延迟、Cookie 管理等反爬机制,结合 Selenium/Playwright 可以模拟真实用户行为。 |

同样强大。Puppeteer/Playwright 可以轻松控制浏览器,处理 JavaScript 渲染的页面,模拟鼠标、键盘、网络请求等,是目前处理动态页面的“杀手锏”。 |

| 部署与运维 | 简单直接,可以打包成单个 .py 文件或使用 Docker,部署脚本到服务器非常方便。 |

依赖 Node.js 环境,需要确保服务器上安装了特定版本的 Node.js。npm 生态管理依赖也很方便,使用 Docker 是最佳实践。 |

| 跨平台能力 | 极佳,Python 代码可以轻松地在 Windows, macOS, Linux 上运行,基本无需修改。 | 极佳,Node.js 同样是跨平台的。 |

详细分析

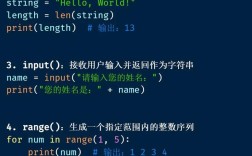

Python: 爬虫领域的“瑞士军刀”

Python 在爬虫领域占据主导地位,这主要归功于其无与伦比的生态系统。

核心优势:

-

丰富的库生态:

requests+BeautifulSoup/lxml:这是最经典、最轻量级的静态网页爬虫组合。requests发送 HTTP 请求,BeautifulSoup解析 HTML,简单高效。Scrapy:一个功能强大的爬虫框架,它提供了数据提取、多线程、队列管理、中间件、管道等全套解决方案,适合构建大型、可维护的爬虫项目。Selenium/Playwright(Python版):当你需要爬取由 JavaScript 动态生成内容的网站时,这两个库可以驱动真实的浏览器(如 Chrome, Firefox)来访问页面,获取最终渲染后的 HTML。

-

语法简洁,开发效率高: Python 的代码可读性非常高,用更少的代码就能实现功能,让你更专注于爬虫的逻辑本身。

-

强大的数据处理能力: 爬取的数据通常需要清洗和分析,Python 的

Pandas,NumPy等库在数据处理方面是行业标杆,可以无缝衔接,完成从爬取到分析的整个流程。 (图片来源网络,侵删)

(图片来源网络,侵删)

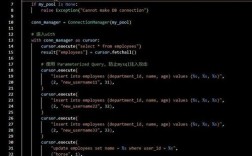

典型工作流 (Python):

import requests

from bs4 import BeautifulSoup

# 1. 发送 HTTP 请求

url = 'https://example.com'

response = requests.get(url, headers={'User-Agent': 'My-Bot/1.0'})

# 2. 解析 HTML

soup = BeautifulSoup(response.text, 'html.parser')

# 3. 提取数据= soup.find('h1').text

links = [a['href'] for a in soup.find_all('a', href=True)]

# 4. 存储数据

print(f"Title: {title}")

print(f"Found {len(links)} links.")

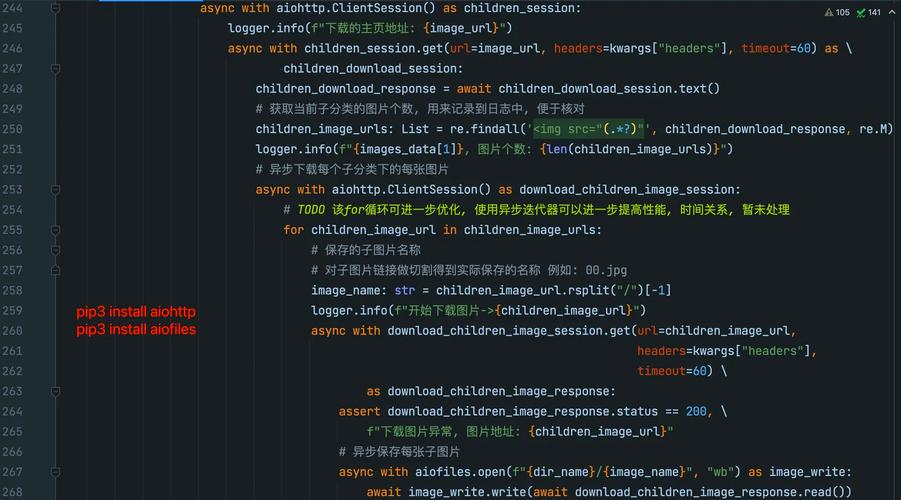

JavaScript (Node.js): 现代化与浏览器自动化的“利器”

如果你是前端开发者,或者你的项目本身就是一个基于 Node.js 的全栈应用,使用 JS 进行爬虫开发会非常自然。

核心优势:

-

无与伦比的浏览器自动化能力:

(图片来源网络,侵删)

(图片来源网络,侵删)Puppeteer和Playwright是 JS 生态的王牌,它们可以控制一个无头浏览器(Headless Browser),这意味着你可以在不打开浏览器界面的情况下,像真实用户一样点击、输入、等待页面加载,甚至拦截和修改网络请求,对于现代 SPA(单页应用)网站,JS 是最佳选择。

-

异步编程的优雅: Node.js 的

async/await语法让异步代码看起来像同步代码一样清晰,非常适合处理大量并发的网络请求,而不会陷入“回调地狱”。 -

前后端技术栈统一: 如果你的团队已经使用 JS/TS 进行前端和后端开发,引入爬虫功能可以保持技术栈的一致性,便于维护和协作。

-

与前端工具链无缝集成: 可以轻松地将爬虫脚本与构建工具(如 Webpack)或开发服务器集成,实现一些自动化的前端数据抓取任务。

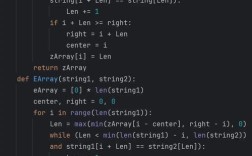

典型工作流 (Node.js with Puppeteer):

const puppeteer = require('puppeteer');

(async () => {

// 1. 启动浏览器

const browser = await puppeteer.launch();

const page = await browser.newPage();

// 2. 访问网页

await page.goto('https://example.com');

// 3. 等待并提取数据 (可以等待某个元素出现)

const title = await page.evaluate(() => {

return document.querySelector('h1').innerText;

});

// 4. 存储数据

console.log(`Title: ${title}`);

// 5. 关闭浏览器

await browser.close();

})();

如何选择?一张图帮你决定

graph TD

A[开始爬虫项目] --> B{页面是静态的吗?};

B -- 是 --> C{项目规模小/快速原型?};

B -- 否 --> D{必须使用 JS 模拟用户行为?};

C -- 是 --> E[Python: requests + BeautifulSoup];

C -- 否 --> F[Python: Scrapy 框架];

D -- 是 --> G[JavaScript: Puppeteer/Playwright];

D -- 否 --> H{团队是 JS 全栈吗?};

H -- 是 --> G;

H -- 否 --> F;

总结建议:

-

选择 Python,

- 你是爬虫新手,希望快速上手。

- 你需要爬取大量静态页面或 API。

- 你的项目需要强大的数据处理和分析能力。

- 你希望使用成熟、稳定、文档丰富的框架(如 Scrapy)。

- 你的目标是通用性和广泛的社区支持。

-

选择 JavaScript (Node.js),

- 你是前端/全栈开发者,熟悉 JS 生态。

- 你的核心任务是处理高度动态的网页,必须依赖浏览器环境。

- 你的项目本身就是一个 Node.js 应用,需要集成爬虫功能。

- 你对性能要求极高,特别是需要成千上万个并发请求时(在 I/O 密集型场景下)。

- 你需要精细地模拟用户交互,比如处理复杂的点击、拖拽、等待等。

最终结论:

两者都是非常优秀的爬虫工具。Python 在通用性、库的广度和数据处理方面略胜一筹,是爬虫领域的“标准答案”,而 JavaScript 在浏览器自动化和与现代 Web 技术栈的融合方面具有独特优势,是处理动态页面的“终极武器”。

对于绝大多数爬虫任务,Python 都是更安全、更高效的选择,但当你遇到 Python + Selenium 也难以解决的、极度复杂的动态页面时,Puppeteer/Playwright 往往能迎刃而解。