- 理解 MapReduce 核心概念:回顾 MapReduce 的工作流程。

- 实现基础组件:创建 Mapper 和 Reducer 的基类。

- 编写一个具体示例:实现一个经典的 "Word Count"(单词计数)程序。

- 整合与执行:将所有部分组合起来,并在单机上模拟执行。

- 进阶与局限性:讨论这个简单实现的局限性以及如何进行扩展。

MapReduce 核心概念回顾

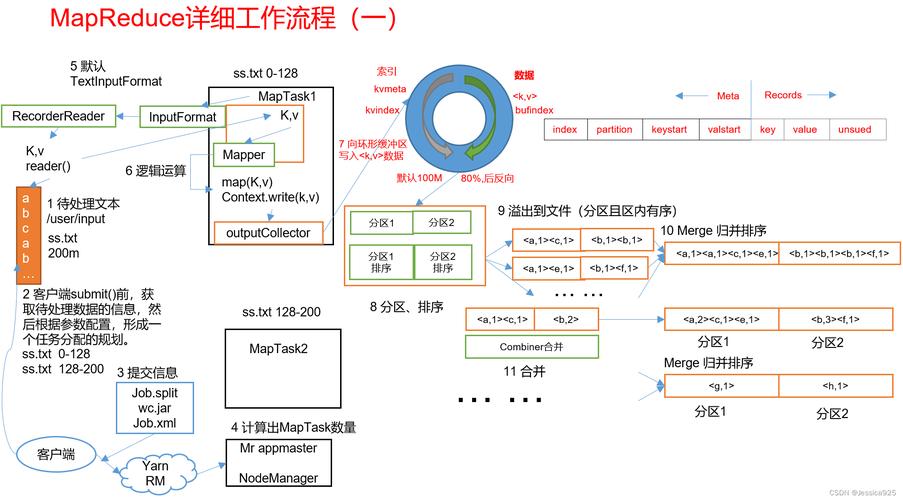

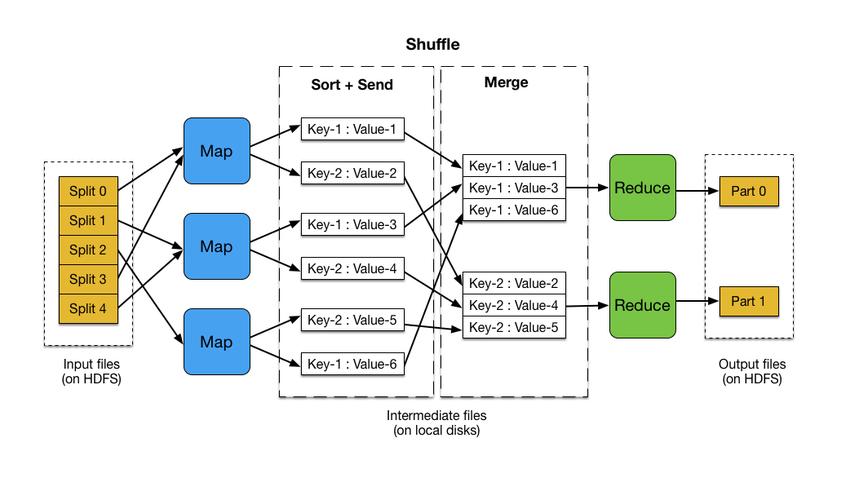

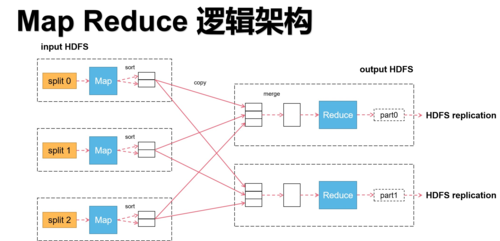

MapReduce 是一种编程模型,用于处理和生成大型数据集,其核心思想是“分而治之”(Divide and Conquer),整个过程分为两个主要阶段:

-

Map 阶段 (映射阶段):

- 输入:一组键值对,通常是

(key, value)。 - 处理:Mapper 函数接收一个输入键值对,处理后输出一个或多个中间键值对,这个过程是并行的,每个 Mapper 独立处理一部分数据。

- 输出:一组中间键值对,

(word, 1)。

- 输入:一组键值对,通常是

-

Shuffle and Sort 阶段 (洗牌与排序阶段):

- 处理:这是 MapReduce 的“魔法”所在,框架会自动收集所有 Mapper 的输出,并根据键进行分组和排序,所有相同键的值会被发送到同一个 Reducer。

- 输出:重新组织后的数据,形式为

(key, [value1, value2, ...])。('hello', [1, 1, 1])。

-

Reduce 阶段 (归约阶段):

- 输入:一个键和与该键关联的所有值的列表,即

(key, [values])。 - 处理:Reducer 函数接收一个键和它的值列表,处理后输出最终的键值对,这个过程也是并行的。

- 输出:最终的键值对,

('hello', 3)。

- 输入:一个键和与该键关联的所有值的列表,即

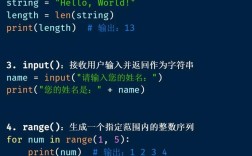

实现基础组件

我们首先定义 Mapper 和 Reducer 的基类,这只是一个规范,提醒用户需要实现哪些方法。

# mapper_base.py

class Mapper:

"""

Mapper 基类。

用户需要继承此类并实现 map() 方法。

"""

def map(self, key, value):

"""

处理输入的键值对,并生成一个或多个中间键值对。

:param key: 输入的键

:param value: 输入的值

:return: 生成器,产生中间键值对 (key, value)

"""

raise NotImplementedError("子类必须实现 map 方法")

# reducer_base.py

class Reducer:

"""

Reducer 基类。

用户需要继承此类并实现 reduce() 方法。

"""

def reduce(self, key, values):

"""

处理一个键及其关联的所有值,并生成最终的键值对。

:param key: 中间键

:param values: 与该键关联的所有值的列表

:return: 生成器,产生最终键值对 (key, value)

"""

raise NotImplementedError("子类必须实现 reduce 方法")

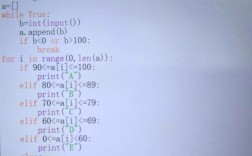

编写一个具体示例:Word Count

我们来实现一个单词计数程序,这个程序的目标是统计一个文本文件中每个单词出现的次数。

1 实现 Mapper 和 Reducer

Mapper:对于输入的每一行文本(键是行号,值是文本内容),我们将文本分割成单词,并为每个单词输出 (word, 1)。

Reducer:对于每个单词(键)和它对应的 1 的列表(值),我们将列表中的所有 1 相加,得到单词的总数。

# wordcount_mapper.py

from mapper_base import Mapper

class WordCountMapper(Mapper):

def map(self, key, value):

"""

将一行文本分割成单词,并为每个单词生成 (word, 1)。

:param key: 行号 (我们在这里不使用它)

:param value: 文本行内容

"""

# 将文本转换为小写,并用非字母字符分割

words = value.lower().split()

for word in words:

# 过滤掉空字符串

if word:

yield (word, 1)

# wordcount_reducer.py

from reducer_base import Reducer

class WordCountReducer(Reducer):

def reduce(self, key, values):

"""

对一个单词的所有计数进行求和。

:param key: 单词

:param values: 一个包含多个 1 的列表,[1, 1, 1]

"""

# sum() 函数可以完美地对列表中的所有值求和

yield (key, sum(values))

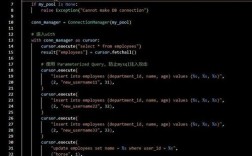

整合与执行:MapReduce 引擎

这是最核心的部分,我们将创建一个 MapReduceEngine 类来模拟整个 MapReduce 流程,由于是单机实现,这个“引擎”只是一个普通的 Python 程序。

# mapreduce_engine.py

from collections import defaultdict

class MapReduceEngine:

def __init__(self, mapper, reducer):

"""

初始化 MapReduce 引擎。

:param mapper: Mapper 类的实例

:param reducer: Reducer 类的实例

"""

self.mapper = mapper

self.reducer = reducer

def run(self, data):

"""

执行 MapReduce 作业。

:param data: 可迭代的数据源,例如一个包含多行文本的列表

:return: 一个字典,包含最终的 (key, value) 对

"""

# --- 1. Map 阶段 ---

# 我们使用一个列表来存储所有 Mapper 的输出

# 在分布式系统中,这个列表会被分布在不同的节点上

intermediate_pairs = []

for i, line in enumerate(data):

# 模拟输入为 (行号, 文本内容)

# 调用 mapper 的 map 方法,并收集其产出

for key, value in self.mapper.map(i, line):

intermediate_pairs.append((key, value))

# --- 2. Shuffle and Sort 阶段 ---

# 使用 defaultdict 来自动对具有相同键的值进行分组

# 这是模拟 shuffle 过程的核心

grouped_data = defaultdict(list)

for key, value in intermediate_pairs:

grouped_data[key].append(value)

# --- 3. Reduce 阶段 ---

# 遍历分组后的数据,调用 reducer

final_results = {}

for key, values in grouped_data.items():

for final_key, final_value in self.reducer.reduce(key, values):

final_results[final_key] = final_value

return final_results

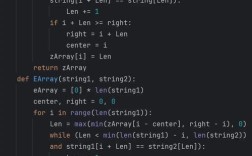

完整的 Word Count 程序

我们把所有部分组合起来,创建一个可运行的脚本。

# main.py

from mapreduce_engine import MapReduceEngine

from wordcount_mapper import WordCountMapper

from wordcount_reducer import WordCountReducer

# 1. 准备输入数据

# 在真实场景中,这可能是一个巨大的文件

# 我们这里用一个列表来模拟

input_data = [

"hello world",

"hello python",

"world of mapreduce",

"python is great"

]

# 2. 创建 Mapper 和 Reducer 的实例

mapper_instance = WordCountMapper()

reducer_instance = WordCountReducer()

# 3. 创建 MapReduce 引擎

engine = MapReduceEngine(mapper_instance, reducer_instance)

# 4. 运行作业

print("开始执行 MapReduce 作业...")

final_results = engine.run(input_data)

# 5. 打印结果

print("\n最终结果:")

for word, count in sorted(final_results.items()):

print(f"'{word}': {count}")

运行 main.py 的输出:

开始执行 MapReduce 作业...

最终结果:

'great': 1

'hello': 2

'is': 1

'mapreduce': 1

'of': 1

'python': 2

'world': 2进阶与局限性

这个简单的 Python 实现很好地展示了 MapReduce 的逻辑,但它远不是一个真正的分布式计算系统,它有以下明显的局限性:

- 单机执行:所有计算都在一台机器的一个进程中完成,没有利用多台计算机的集群资源。

- 内存限制:

Shuffle and Sort阶段将所有中间数据都加载到内存的defaultdict中,对于海量数据(如 TB 级),这会导致内存溢出。 - 缺乏容错:如果某个 Mapper 或 Reducer 失败,整个任务就会失败,真正的分布式系统会重新执行失败的任务。

- 没有并行化:

map和reduce阶段的循环是顺序执行的,真正的 MapReduce 会将任务分发给多个工作节点并行处理。 - 数据源单一:输入数据被硬编码为一个列表,真实系统需要能从 HDFS (Hadoop Distributed File System) 或 S3 等分布式存储中读取数据。

如何扩展?

- 并行化 (Multiprocessing/Threading):为了利用多核 CPU,你可以使用 Python 的

multiprocessing模块来并行运行 Mapper 和 Reducer 任务,每个任务可以处理输入数据的一个分片。 - 磁盘溢出:当中间数据太大无法放入内存时,可以将部分数据溢出到磁盘上,这需要更复杂的排序和合并逻辑。

- 分布式任务调度:要实现真正的分布式,你需要一个任务调度器,它可以将任务分配给集群中的不同工作节点,并监控它们的执行状态,这是一个非常复杂的系统构建。

- 使用现有库:对于实际的 Python 项目,有更成熟的库可以提供 MapReduce 功能,

- PySpark:Apache Spark 的 Python API,是目前大数据处理的事实标准,它提供了 RDD(弹性分布式数据集)和 DataFrame API,底层实现了优化的 MapReduce 和 DAG (有向无环图) 执行引擎。

- Disco:一个用 Erlang 编写的 MapReduce 框架,提供了 Python API。

- mrjob:一个来自 Yelp 的库,可以在本地、Amazon EMR 或其他 Hadoop 集群上轻松编写和运行 MapReduce 作业。

通过这个简单的实现,我们清晰地看到了 MapReduce 的三个核心阶段:Map、Shuffle/Sort 和 Reduce,虽然它不能处理大数据,但它是一个极佳的学习工具,能够帮助开发者深入理解 MapReduce 的设计哲学和工作原理,为学习更复杂的分布式计算框架(如 Spark)打下坚实的基础。