- 为什么高并发是 Socket 编程的挑战?

- 高并发的核心思想:I/O 模型演进

- Java 中的实现方案(从传统到现代)

- 传统 BIO (Blocking I/O)

- 伪异步 NIO (Non-blocking I/O with Selector)

- 真正的 NIO 框架:Netty

- 高并发 Socket 的其他关键要素

- 线程模型

- 数据序列化

- 心跳机制

- 粘包/拆包问题

- 实战建议与最佳实践

为什么高并发是 Socket 编程的挑战?

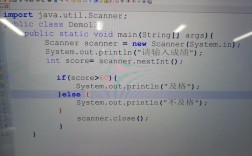

一个最原始的 Socket 服务端代码(BIO 模式)大概是这样的:

// 伪代码

ServerSocket serverSocket = new ServerSocket(8080);

while (true) {

Socket clientSocket = serverSocket.accept(); // 阻塞!等待客户端连接

// 每来一个连接,就创建一个新线程去处理

new Thread(() -> {

handleRequest(clientSocket);

}).start();

}

这个模式在低并发时没问题,但一旦并发量上来,问题就暴露了:

- 资源耗尽:每来一个连接就创建一个线程,线程是操作系统中非常宝贵的资源,创建和销毁线程都有开销,且线程数受限于操作系统和 JVM 的内存,成千上万的连接会瞬间耗尽所有线程。

- 上下文切换开销:线程数量过多,CPU 会花费大量时间在线程的调度和上下文切换上,而不是真正执行业务逻辑,导致系统性能急剧下降。

- 扩展性差:这种模型无法有效利用多核 CPU,因为每个线程都是独立运行的,线程间的同步和通信成本很高。

核心矛盾:操作系统内核和 I/O 设备的速度(纳秒/微秒级)远快于应用程序处理请求的速度(毫秒/秒级),如果应用程序在等待 I/O(如网络数据到达)时被阻塞,那么大部分时间 CPU 都在空闲,造成了巨大的资源浪费。

高并发的核心思想:I/O 模型演进

为了解决 BIO 的问题,I/O 模型经历了多次演进,核心思想都是“避免让应用线程在等待 I/O 时被阻塞”。

a) 阻塞 I/O (Blocking I/O - BIO)

就是我们上面写的最原始的模型,应用程序发起 read 调用后,会一直阻塞,直到数据从内核缓冲区拷贝到用户空间缓冲区才返回。

- 优点:模型简单,编码容易。

- 缺点:性能极差,无法处理高并发。

b) 非阻塞 I/O (Non-blocking I/O - NIO)

应用程序发起 read 调用后,如果内核缓冲区没有数据,系统会立即返回一个错误码(如 EWOULDBLOCK),而不是阻塞,应用程序需要不断地轮询(polling),直到数据准备好。

- 优点:线程不会被阻塞,可以同时做其他事情。

- 缺点:需要用户线程不断轮询,会消耗大量 CPU 时间,效率不高。

c) I/O 多路复用 (I/O Multiplexing - NIO 的核心)

这是 NIO 模型的精髓,它允许单个线程同时监视多个 I/O 流,一旦某个 I/O 流就绪(数据已到达),线程就去处理它。

-

实现方式:

select:早期的实现,有文件描述符数量限制(通常是 1024),并且是水平触发(只要缓冲区有数据,每次select都会返回),需要用户程序不断处理。poll:解决了select的数量限制,但性能随描述符数量增加而线性下降。epoll(Linux):Linux 下最高效的实现,它没有数量限制,并且是边缘触发(只有数据状态发生变化时,如从无到有,才会通知),效率极高。kqueue(BSD/macOS):与epoll类似的高效实现。- Java NIO 中的

Selector就是基于这些底层机制实现的。

-

工作流程:

- 将多个

Socket通道注册到Selector上,并设置感兴趣的事件(如SelectionKey.OP_ACCEPT,SelectionKey.OP_READ)。 - 调用

Selector.select(),线程会进入阻塞状态,但不是阻塞在某个Socket上,而是阻塞在Selector上。 - 当任何一个注册的

Socket通道上有事件发生时,select()方法会返回。 - 遍历

Selector返回的SelectionKey集合,找到就绪的通道,进行处理。

- 将多个

优点:用一个线程管理成百上千的连接,大大减少了线程数量和上下文切换开销,是高并发的基础。

d) 信号驱动 I/O (Signal-Driven I/O - SIGIO)

应用程序请求内核在数据就绪时发送一个信号,应用程序捕获信号后进行 read 操作,它仍然需要一次系统调用,但阻塞时间很短。

e) 异步 I/O (Asynchronous I/O - AIO)

这是最理想的模型,应用程序发起 read 调用后,会立即返回,可以继续做其他事情,当数据准备好并拷贝到用户空间后,内核会通知应用程序(通过回调或事件)。

- Java 7+ 引入了

java.nio.channels.AsynchronousSocketChannel,它在 Windows (IOCP) 和 Linux (AIO) 上有原生支持。 - 现状:在 Linux 上,AIO 的成熟度和性能有时不如

epoll,因此在很多高性能场景下,基于epoll的 NIO 框架(如 Netty)仍然是首选。

Java 中的实现方案

a) 传统 BIO (已不推荐用于高并发)

如上所述,每个连接一个线程,可以通过“线程池”来优化,避免无限创建线程,但无法解决线程数受限于连接数的问题。

// 伪代码 - 使用线程池的 BIO

ExecutorService threadPool = Executors.newFixedThreadPool(200);

ServerSocket serverSocket = new ServerSocket(8080);

while (true) {

Socket clientSocket = serverSocket.accept();

threadPool.execute(() -> handleRequest(clientSocket));

}

适用场景:连接数非常少且固定的场景,如内部系统通信。

b) 伪异步 NIO (Java NIO 原生 API)

使用 Selector 和 SocketChannel 实现多路复用。

// 伪代码 - Java NIO

Selector selector = Selector.open();

ServerSocketChannel serverSocketChannel = ServerSocketChannel.open();

serverSocketChannel.configureBlocking(false);

serverSocketChannel.register(selector, SelectionKey.OP_ACCEPT);

while (true) {

selector.select(); // 阻塞,等待事件

Iterator<SelectionKey> it = selector.selectedKeys().iterator();

while (it.hasNext()) {

SelectionKey key = it.next();

it.remove();

if (key.isAcceptable()) {

// 处理连接

}

if (key.isReadable()) {

// 处理读

}

}

}

问题:

- 代码复杂:需要处理

SelectionKey、ByteBuffer,代码繁琐且容易出错。 - NIO Bug:JDK NIO 的

Selector在 Linux 平台下,select()方法存在著名的 "epoll 空转 Bug"(CPU 100%),需要通过wakeup()或重建Selector来规避。 - 功能有限:需要自己实现很多高级功能,如编解码、心跳、半包处理等。

直接使用原生 NIO API 开发高并发服务门槛高、风险大,不推荐。

c) 真正的 NIO 框架:Netty (业界标准)

Netty 是一个基于 Java NIO 的高性能、异步事件驱动的网络应用框架,它极大地简化了网络编程的复杂性,并解决了原生 NIO 的诸多问题。

为什么选择 Netty?

- 设计优雅:Reactor 线程模型(主从 Reactor),灵活且性能卓越。

- 功能强大:内置了丰富的编解码器、支持多种协议(HTTP、WebSocket、Protobuf 等)、提供了优雅的线程模型。

- 性能卓越:通过零拷贝(

FileRegion)、内存池(ByteBuf)、高效的事件循环等机制,性能远超原生 NIO 和 BIO。 - 稳定可靠:经过无数商业项目(如 Dubbo、Elasticsearch、RocketMQ 等)的严苛考验,Bug 少,稳定性高。

- 社区活跃:文档完善,社区活跃,问题能及时得到解决。

Netty 核心组件:

Channel:代表一个打开的、可以进行 I/O 操作的连接,如Socket。EventLoop:Netty 的“心脏”,它是一个处理ChannelI/O 操作和事件执行的单线程事件循环,一个EventLoop会绑定一个Thread,并且会处理一个或多个Channel。EventLoopGroup:EventLoop的组,用于创建和管理EventLoop,通常有两个:bossGroup(处理连接) 和workerGroup(处理 I/O)。Bootstrap/ServerBootstrap:Netty 的启动辅助类,用于配置和启动客户端或服务端。ChannelPipeline&ChannelHandler:责任链模式。ChannelPipeline是一个ChannelHandler的列表,当事件发生时,会依次经过Pipeline上的Handler进行处理,这是 Netty 实现灵活业务逻辑的核心。

一个简单的 Netty Echo 服务端示例:

public class NettyEchoServer {

public static void main(String[] args) {

EventLoopGroup bossGroup = new NioEventLoopGroup(1); // Boss, 处理连接

EventLoopGroup workerGroup = new NioEventLoopGroup(); // Worker, 处理I/O

try {

ServerBootstrap b = new ServerBootstrap();

b.group(bossGroup, workerGroup)

.channel(NioServerSocketChannel.class)

.childHandler(new ChannelInitializer<SocketChannel>() {

@Override

public void initChannel(SocketChannel ch) {

// 添加处理器:解码器 -> 业务处理器 -> 编码器

ch.pipeline().addLast(new StringDecoder());

ch.pipeline().addLast(new StringEncoder());

ch.pipeline().addLast(new EchoServerHandler());

}

});

ChannelFuture f = b.bind(8080).sync();

System.out.println("Netty Echo Server started on port 8080...");

f.channel().closeFuture().sync();

} finally {

bossGroup.shutdownGracefully();

workerGroup.shutdownGracefully();

}

}

}

// 业务处理器

class EchoServerHandler extends SimpleChannelInboundHandler<String> {

@Override

protected void channelRead0(ChannelHandlerContext ctx, String msg) {

System.out.println("Received: " + msg);

ctx.writeAndFlush("Server Echo: " + msg + "\n");

}

@Override

public void exceptionCaught(ChannelHandlerContext ctx, Throwable cause) {

cause.printStackTrace();

ctx.close();

}

}

高并发 Socket 的其他关键要素

除了选择正确的 I/O 模型和框架,还有几个点至关重要:

a) 线程模型

- Reactor 模型:Netty 的核心,分为单 Reactor 单线程、单 Reactor 多线程、主从 Reactor 多线程,Netty 采用的是主从 Reactor 多线程模型,是目前业界最优秀的模型之一,既能充分利用多核 CPU,又能避免多线程竞争。

- 线程池:对于耗时较长的业务逻辑,不要放在

EventLoop线程中执行,否则会阻塞 I/O,导致整个系统吞吐量下降,应该将其提交到专门的业务线程池中处理。

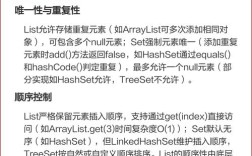

b) 数据序列化

网络传输中,对象需要被转换成字节流(序列化),接收方再将其还原成对象(反序列化)。

- JSON:简单易读,但体积较大,性能一般。

- XML:可读性好,但更冗重,性能差。

- Protobuf / Thrift / Avro:二进制协议,体积小、解析快、跨语言,是高并发系统中的首选,Netty 对 Protobuf 有很好的支持。

- 自定义二进制协议:性能最高,但开发成本高,需要自己定义协议格式(如魔数、版本号、长度、命令字、数据、校验和等)。

c) 心跳机制

为了检测客户端是否异常断开(如网络故障、客户端崩溃),服务端需要主动发起心跳检测。

- 实现方式:可以由客户端定期发送一个心跳包(如

ping),服务端收到后回复pong,如果服务端在一定时间内没有收到某个客户端的心跳,则认为该客户端已下线,关闭其连接。 - Netty 实现:可以在

ChannelPipeline中加入一个IdleStateHandler,当连接空闲时间过长时,会触发一个IdleStateEvent事件,你可以在ChannelHandler中捕获并处理。

d) 粘包/拆包问题

TCP 是一个“流”协议,它只保证数据按序到达,但不保证每次 read 调用能读取到一个完整的应用层数据包,这可能导致:

- 粘包:发送方发送了两个包,接收方只读取了一次,收到了两个包的数据粘在一起。

- 拆包:发送方发送了一个大包,但接收方因为缓冲区大小限制,分两次才读完。

解决方案:定义应用层协议,在数据包之间加入边界。

- 固定长度:每个数据包的长度固定,简单但浪费空间。

- 特殊分隔符:使用特殊字符(如

\r\n)作为包的结束标志,HTTP 协议就是这样。 - 长度字段:在每个数据包的头部增加一个长度字段,指明包体的长度,这是最常用、最灵活的方式,Protobuf 等协议也隐式地使用了这种方式。

Netty 提供了多种 Decoder 来处理这些问题,如 FixedLengthFrameDecoder、DelimiterBasedFrameDecoder、LengthFieldPrepender 和 LengthFieldBasedFrameDecoder。

实战建议与最佳实践

- 首选 Netty:除非有非常特殊的需求,否则不要自己用原生 NIO 去造轮子,直接使用 Netty,它能让你专注于业务逻辑,而不是底层的 I/O 细节。

- 设计清晰的协议:在项目初期就设计好应用层通信协议,特别是要解决粘包/拆包问题,一个好的协议是稳定通信的基石。

- 不要阻塞 EventLoop:牢记

EventLoop线程是黄金线程,只负责 I/O 和快速任务,耗时任务(如数据库查询、复杂计算)必须交给业务线程池。 - 合理配置线程数:

bossGroup通常设置为 1 即可。workerGroup的线程数通常设置为CPU 核心数 * 2。

- 使用高性能序列化:对性能敏感的系统,优先考虑 Protobuf、Thrift 等二进制序列化方案。

- 资源管理:优雅关闭

EventLoopGroup和Channel,防止资源泄漏,使用try-finally或shutdownGracefully()。 - 监控与调优:使用 Arthas、JProfiler 等工具监控内存、CPU 和线程状态,对 Netty 的

ByteBuf池、TCP 参数(如SO_RCVBUF)等进行调优。

| 特性 | BIO (传统) | NIO (原生) | Netty (框架) |

|---|---|---|---|

| I/O 模型 | 阻塞 I/O | I/O 多路复用 | I/O 多路复用 |

| 线程模型 | 一连接一线程 | 一Selector 多连接 | 主从 Reactor 多线程 |

| 并发能力 | 极差 | 高 | 极高 |

| 开发难度 | 简单 | 复杂 | 简单 |

| 稳定性 | 一般 | 较差 (有 Bug) | 高 |

| 功能丰富度 | 低 | 低 | 极高 |

| 适用场景 | 少量、固定连接 | 学习、简单应用 | 高并发、高性能网络服务 |

对于 Java Socket 高并发开发,Netty 是目前事实上的标准答案,理解其背后的 I/O 模型和 Reactor 线程模型,是成为一名优秀后端开发者的必备技能。