⚠️ 重要声明与法律风险提示

在开始之前,我必须强调以下几点,这至关重要:

- Facebook 的服务条款:Facebook 明确禁止未经其明确许可的自动化数据抓取,任何爬虫行为都违反了其 ToS,如果你因此导致你的账户被封禁,Facebook 没有义务为你解封。

- 法律风险:在许多国家和地区,未经授权抓取受版权保护或个人身份信息的数据是违法的,你需要确保你的爬取行为符合当地的法律法规(GDPR)。

- 技术难度:Facebook 拥有非常强大的反爬虫机制,他们使用验证码、IP 封禁、设备指纹、行为分析等多种手段来阻止自动化访问,一个稳定的爬虫需要非常复杂的技术和持续的维护。

- 道德考量:在抓取数据前,请考虑数据隐私和对他人的影响,只抓取你真正需要且公开的信息,并尊重平台的规则。

基于以上风险,本回答将侧重于技术原理、合法合规的替代方案以及“学习目的”的简单示例,而不是提供用于生产环境的、可以大规模抓取 Facebook 的完整代码。

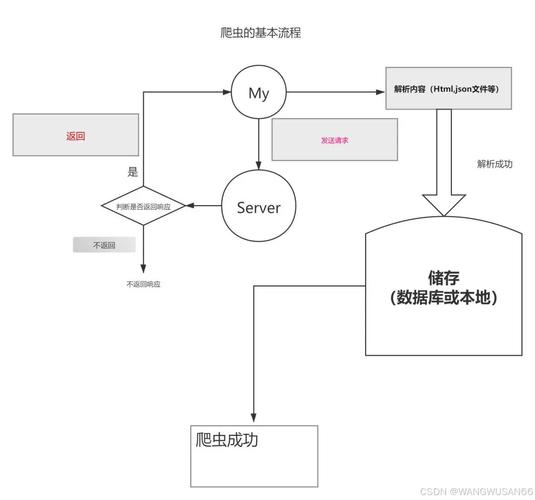

为什么 Facebook 爬虫如此困难?

要理解为什么它难,首先要了解 Facebook 的防御机制:

- 登录验证:几乎所有有价值的数据都需要登录才能访问,这意味着你不能简单地发送 HTTP 请求,而是需要处理会话、Cookie、CSRF Token 等。

- 动态加载:Facebook 的页面内容(尤其是评论、更多帖子)是通过 JavaScript 动态加载的,传统的

requests+BeautifulSoup方法只能获取到初始的 HTML,而抓不到动态加载的内容。 - 验证码:当你频繁请求时,Facebook 会弹出验证码,要求你证明自己是人类。

- IP 封禁:如果同一个 IP 地址在短时间内发出大量请求,它会被暂时或永久封禁。

- Selenium 检测:像 Selenium 这样的浏览器自动化工具很容易被检测到,Facebook 会通过检测浏览器窗口特征、加载的插件、鼠标移动轨迹等来判断你是否是真人。

- API 限制:Facebook 提供了官方 API,但有严格的调用频率限制和审核流程,不适合大规模爬取。

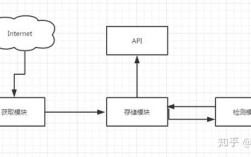

技术方案与实现路径

尽管困难,但技术上仍然有几种路径可以实现,我们从最简单、最推荐的开始。

使用 Facebook 官方 API (最推荐、最合法)

这是唯一合规、稳定且受支持的方式,它适用于需要结构化数据的应用,如分析公共主页、发布帖子、管理广告等。

优点:

- 完全合法:在遵守 API 政策的前提下使用。

- 稳定可靠:由 Facebook 维护,不会轻易失效。

- 数据结构化:返回 JSON 格式的数据,易于处理。

- 有配额限制:但可以申请提高。

缺点:

- 无法获取所有数据:你无法通过官方 API 获取任意用户的个人动态或评论。

- 需要审核:某些权限需要提交申请并经过 Facebook 审核才能获得。

- 有学习成本:需要理解 OAuth 2.0 认证流程。

实现步骤:

-

创建开发者账户和 App:

- 访问 Facebook for Developers。

- 创建一个新的 App,选择 "其他" 或你需要的类型。

- 获取你的

App ID和App Secret。

-

获取 Access Token:

- API 调用需要 Access Token,对于简单测试,可以使用 "User Token"。

- 你需要构造一个 URL 并用浏览器访问它来获取 Token。

https://www.facebook.com/dialog/oauth? client_id=你的_APP_ID& redirect_uri=https://www.example.com/& scope=public_content,pages_read_engagement& response_type=token scope参数是你请求的权限,public_content(公共内容),pages_read_engagement(页面互动数据)。- 访问后,

redirect_uri页面的 URL hash 中会包含access_token=...。

-

使用 Python 调用 API:

- 使用

requests库。

import requests import json # 替换成你自己的 App ID, App Secret 和 Access Token APP_ID = '你的_APP_ID' APP_SECRET = '你的_APP_SECRET' ACCESS_TOKEN = '你的_ACCESS_TOKEN' # 目标页面 ID,The Verge 的主页 ID PAGE_ID = 'themagazine' # API 端点,获取页面的帖子 # Graph API 版本请使用最新的稳定版,v18.0 url = f"https://graph.facebook.com/v18.0/{PAGE_ID}/posts" # 请求参数 params = { 'access_token': ACCESS_TOKEN, 'fields': 'id,message,created_time,likes.summary(true),comments.summary(true)', # 指定你想要的字段 'limit': 5 # 限制返回的帖子数量 } try: response = requests.get(url, params=params) response.raise_for_status() # 如果请求失败则抛出异常 data = response.json() if 'data' in data: print(f"成功获取 {PAGE_ID} 的帖子:") for post in data['data']: print(f"\n--- Post ID: {post['id']} ---") print(f"发布时间: {post['created_time']}") print(f"内容: {post.get('message', '无内容')}") print(f"点赞数: {post['likes']['summary']['total_count']}") print(f"评论数: {post['comments']['summary']['total_count']}") else: print("API 返回错误:", data.get('error', {})) except requests.exceptions.RequestException as e: print(f"请求发生错误: {e}")更多信息请参考官方文档: Graph API 文档

- 使用

网页抓取 (高风险,不推荐用于生产)

这种方法是直接模拟浏览器访问网页并解析 HTML。请仅用于学习目的,并严格遵守 Facebook 的 ToS。

技术栈:

- Selenium: 用于自动化控制真实浏览器(如 Chrome),以执行 JavaScript 并获取完整的页面内容。

- Beautiful Soup: 用于解析 Selenium 获取到的 HTML,并提取你需要的数据。

- WebDriver Manager: 用于自动管理浏览器驱动程序,免去手动下载驱动的麻烦。

实现步骤:

-

安装必要的库:

pip install selenium beautifulsoup4 webdriver-manager

-

编写 Python 代码示例: 这个例子会打开 Chrome 浏览器,登录你的 Facebook 账户,然后抓取你主页的帖子标题。

import time from selenium import webdriver from selenium.webdriver.common.by import By from selenium.webdriver.common.keys import Keys from selenium.webdriver.chrome.service import Service from webdriver_manager.chrome import ChromeDriverManager from bs4 import BeautifulSoup # --- 配置 --- FACEBOOK_EMAIL = '你的_facebook_email@example.com' FACEBOOK_PASSWORD = '你的_facebook_password' TARGET_URL = 'https://www.facebook.com' # 可以改成你想要的页面,比如你的主页 def facebook_scraper(): # 设置 WebDriver # 使用 webdriver-manager 自动下载和配置驱动 service = Service(ChromeDriverManager().install()) options = webdriver.ChromeOptions() # options.add_argument('--headless') # 如果不需要看到浏览器窗口,可以取消注释这行 driver = webdriver.Chrome(service=service, options=options) try: print("正在打开 Facebook...") driver.get(TARGET_URL) time.sleep(3) # 等待页面加载 # --- 登录流程 --- print("正在尝试登录...") email_input = driver.find_element(By.ID, 'email') password_input = driver.find_element(By.ID, 'pass') login_button = driver.find_element(By.NAME, 'login') email_input.send_keys(FACEBOOK_EMAIL) password_input.send_keys(FACEBOOK_PASSWORD) login_button.click() print("登录成功,等待页面跳转...") time.sleep(10) # 等待登录后的页面加载,这个时间可能需要调整 # --- 数据抓取 --- print("正在抓取页面内容...") # 获取渲染后的页面源代码 page_source = driver.page_source soup = BeautifulSoup(page_source, 'html.parser') # 使用更健壮的选择器来查找帖子 # Facebook 的 class 名经常变化,这里的选择器可能很快失效 # 这是一个示例,你需要根据实际页面结构来调整 posts = soup.find_all('div', {'data-pagelet': 'ProfileFeed'}) if not posts: print("警告:未找到帖子,可能选择器已失效或页面结构不同。") # 尝试另一种常见的 class 名 posts = soup.find_all('div', role='article') print(f"找到 {len(posts)} 个潜在的帖子元素。") for i, post in enumerate(posts[:5]): # 只处理前5个 try: # 尝试找到帖子内容,选择器同样可能失效 content_div = post.find('div', {'data-ad-preview': 'message'}) if content_div: print(f"\n--- 帖子 {i+1} ---") print(content_div.get_text(strip=True)) except Exception as e: print(f"解析第 {i+1} 个帖子时出错: {e}") continue except Exception as e: print(f"发生错误: {e}") finally: print("任务完成,关闭浏览器。") driver.quit() if __name__ == '__main__': facebook_scraper()

这个代码的局限性:

- 极易失效:Facebook 随时可能改变其 HTML 结构或 class 名,导致你的选择器失效,代码无法运行。

- 速度慢:启动真实浏览器比直接发送 HTTP 请求慢得多。

- 容易被检测:Facebook 可以轻易检测到 Selenium,并可能要求你进行额外的验证或直接封禁你的账户/IP。

- 维护成本高:你需要不断地更新代码以适应 Facebook 的变化。

合法合规的替代方案

与其冒着巨大风险去爬取,不如考虑这些更安全、更可持续的替代方案:

- 使用 Facebook 官方 API:如前所述,这是首选。

- 使用第三方数据提供商:许多公司(如 Sprout Social, Hootsuite, Brandwatch)已经合法地获得了数据授权,并提供 API 或数据导出服务,你可以通过他们的平台获取分析。

- 手动复制粘贴:对于一次性、小规模的数据需求,这是最简单直接的方法。

- 分析公开数据:关注一些研究机构发布的关于社交媒体趋势的报告,而不是自己去收集原始数据。

| 方法 | 优点 | 缺点 | 推荐度 |

|---|---|---|---|

| Facebook API | 合法、稳定、结构化数据 | 权限有限、需要审核、有配额 | ⭐⭐⭐⭐⭐ (首选) |

| 网页抓取 | 理论上可以获取任何公开数据 | 违法风险高、极易失效、维护成本高、容易被封 | ⭐ (仅限学习) |

| 第三方服务 | 方便、数据全面、合法 | 成本较高 | ⭐⭐⭐⭐ (适合商业用途) |

最终建议:除非你有非常特殊且合法的需求,并且有足够的技术能力和法律资源去应对风险,否则请务必选择 Facebook API 或其他合法替代方案。 不要轻易尝试编写一个用于生产环境的 Facebook 爬虫,这很可能是一场注定失败的消耗战。