(主标题+副标题,兼顾SEO与吸引力)

Java乱码终极指南:5种方法精准判断字符串编码,告别“?”号噩梦 从原理到实战,彻底解决Java开发中的乱码问题,让你的应用国际化无忧

Meta Description)

还在被Java乱码问题困扰?本文深入剖析Java乱码根源,提供5种实用的字符串乱码判断方法(包括String.getBytes()、CharsetDecoder、第三方库等),附完整代码示例与最佳实践,无论你是新手还是资深开发者,都能在这里找到解决乱码问题的终极方案,提升应用健壮性。

内容**

引言:乱码——每个Java开发者都曾遇到的“幽灵”

在Java开发的世界里,乱码(Mojibake)就像一个挥之不去的幽灵,总在不经意间出现,当你从数据库读取的数据显示为,当你从文件中读取的文本变成一堆看不懂的符号,当你与前端进行数据交互时出现编码错乱,你是否感到头疼不已?

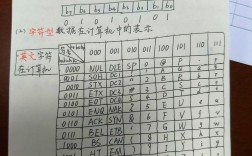

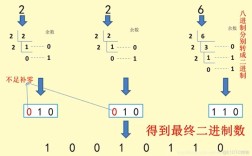

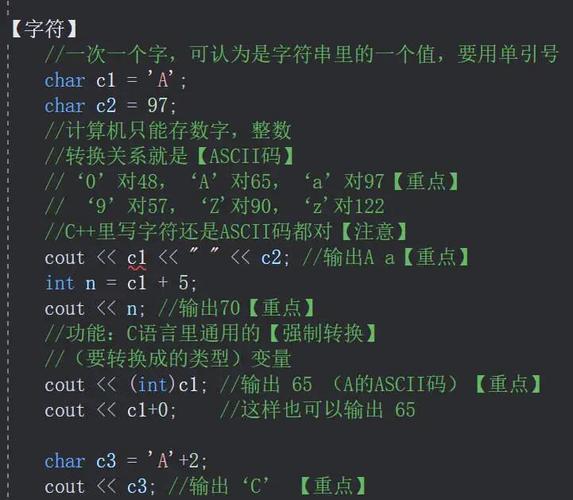

乱码问题的根源,归根结底在于编码(Encoding)与解码(Decoding)的不一致,计算机只认识0和1,而我们人类需要文字,为了将文字与二进制数据对应起来,诞生了各种编码标准,如ISO-8859-1、GBK、UTF-8等,当一段二进制数据被用错误的编码规则去解读时,乱码就产生了。

作为开发者,我们无法控制所有输入源的编码,但我们可以通过主动判断来识别潜在的乱码,从而采取相应措施,我们就来探讨如何在Java中精准判断一个字符串是否是乱码,并提供一套完整的解决方案。

第一部分:乱码判断的核心原理

在动手写代码之前,我们必须理解一个核心原理:一个字符串本身没有“编码”属性,它的编码取决于它被创建时或被转换时所使用的字符集。

当我们说“判断字符串是否是乱码”,我们真正想问的是:“这个字符串是否是用一个错误的字符集(比如ISO-8859-1)去解码了一段原本是其他字符集(比如UTF-8)的字节数据?”

基于这个原理,我们的判断逻辑通常如下:

- 假设一个目标编码:我们期望字符串是

UTF-8编码的。 - 将字符串重新编码:将字符串按照我们假设的目标编码(UTF-8)转换成字节数组。

- 再解码回来:将这个字节数组,用同样的目标编码(UTF-8)重新解码成一个新字符串。

- 比较前后字符串:比较新字符串和原始字符串是否完全相同。

- 如果相同:说明字符串在目标编码下是“自洽”的,很大概率不是乱码。

- 如果不同:说明原始字符串很可能不是用目标编码生成的,极有可能是乱码。

这个“编码-解码-比较”的流程,就是我们判断乱码的核心思想。

第二部分:实战!5种判断Java字符串乱码的方法

下面,我们通过5种由浅入深的方法来实现乱码判断。

String.getBytes() + new String()(最直观,但有缺陷)

这是最朴素、最容易理解的方法,直接套用我们上面的核心原理。

代码示例:

public class MessyCodeChecker {

/**

* 方法一:通过String的getBytes和构造函数进行判断

* @param str 待检查的字符串

* @param charsetName 目标字符集,如 "UTF-8"

* @return 如果字符串在指定字符集下自洽,返回true;否则返回false

*/

public static boolean isMessyCodeByStringMethod(String str, String charsetName) {

if (str == null) {

return false;

}

try {

// 1. 将字符串按目标编码转换为字节数组

byte[] bytes = str.getBytes(charsetName);

// 2. 将字节数组按目标编码重新解码为字符串

String newStr = new String(bytes, charsetName);

// 3. 比较新字符串和原字符串是否相同

return !str.equals(newStr);

} catch (UnsupportedEncodingException e) {

// 如果指定的字符集不被支持,则无法判断

System.err.println("不支持的字符集: " + charsetName);

return false;

}

}

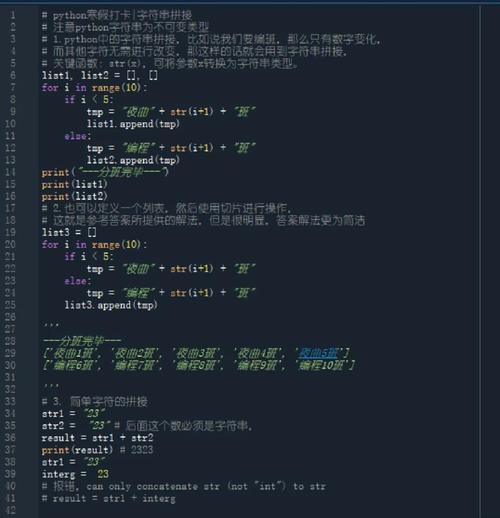

public static void main(String[] args) {

// 示例1:正常的UTF-8字符串

String normalStr = "你好,世界!Hello, World!";

System.out.println("正常字符串判断结果: " + isMessyCodeByStringMethod(normalStr, "UTF-8")); // 应该输出 false

// 示例2:乱码字符串(用GBK解码UTF-8字节)

String messyStr = "浣犲ソ涓�鏈�";

// 这个字符串很可能是UTF-8的字节被错误地用GBK解码了

// 我们尝试用UTF-8去“还原”它

System.out.println("乱码字符串判断结果: " + isMessyCodeByStringMethod(messyStr, "UTF-8")); // 很可能输出 true

// 示例3:乱码字符串(用ISO-8859-1解码UTF-8字节)

String messyStr2 = "ä½ å¥½ï¼Œä¸–ç•Œï¼";

System.out.println("乱码字符串判断结果: " + isMessyCodeByStringMethod(messyStr2, "UTF-8")); // 很可能输出 true

}

}

优点:

- 逻辑简单直观,易于理解。

缺点:

- 性能较差:每次判断都涉及两次编码转换,对于高频调用场景,开销较大。

- 不绝对准确:某些特殊的、巧合的乱码字符串可能会在“编码-解码”后意外地恢复原样,导致误判。

CharsetDecoder(更专业、更可靠)

java.nio.charset包下的CharsetDecoder是处理字符编码的更专业工具,它提供了onMalformedInput和onUnmappableCharacter等策略,可以更精细地控制解码行为。

代码示例:

import java.nio.charset.Charset;

import java.nio.charset.CharsetDecoder;

import java.nio.charset.CodingErrorAction;

import java.nio.ByteBuffer;

import java.nio.CharBuffer;

public class MessyCodeCheckerWithDecoder {

/**

* 方法二:使用CharsetDecoder进行判断

* @param str 待检查的字符串

* @param charset 目标字符集,如 Charset.forName("UTF-8")

* @return 如果字符串在指定字符集下解码失败,则认为是乱码

*/

public static boolean isMessyCodeByDecoder(String str, Charset charset) {

if (str == null) {

return false;

}

CharsetDecoder decoder = charset.newDecoder();

// 设置解码错误处理策略:遇到非法字节序列,报告错误

decoder.onMalformedInput(CodingErrorAction.REPORT);

decoder.onUnmappableCharacter(CodingErrorAction.REPORT);

try {

// 将字符串编码为字节缓冲区

ByteBuffer byteBuffer = ByteBuffer.wrap(str.getBytes(charset.name()));

// 尝试解码

decoder.decode(byteBuffer);

// 如果没有抛出异常,说明解码成功

return false;

} catch (Exception e) {

// 如果抛出异常,说明解码失败,是乱码

return true;

}

}

public static void main(String[] args) {

Charset utf8 = Charset.forName("UTF-8");

String normalStr = "你好,世界!Hello, World!";

System.out.println("正常字符串判断结果: " + isMessyCodeByDecoder(normalStr, utf8)); // false

String messyStr = "浣犲ソ涓�鏈�";

System.out.println("乱码字符串判断结果: " + isMessyCodeByDecoder(messyStr, utf8)); // true

}

}

优点:

- 更可靠:通过

REPORT策略,一旦遇到非法的字节序列,就会立即抛出异常,判断结果非常准确。 - 性能较好:底层实现比

String构造函数更高效。

缺点:

- 代码比方法一略显复杂。

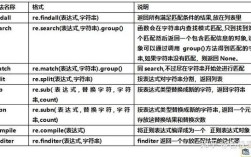

正则表达式(适用于特定场景)

如果你的乱码字符串有非常明显的特征(比如包含大量无法识别的Unicode字符、特定范围的符号等),可以使用正则表达式进行匹配。

代码示例:

import java.util.regex.Pattern;

public class MessyCodeCheckerWithRegex {

/**

* 方法三:使用正则表达式判断(适用于特定场景)

* @param str 待检查的字符串

* @return 如果字符串包含大量非可打印字符或特定乱码模式,返回true

*/

public static boolean isMessyCodeByRegex(String str) {

if (str == null) {

return false;

}

// 匹配包含大量非GBK或UTF-8常见字符的情况

// 这是一个示例正则,实际场景需要根据乱码特征调整

// 这个正则匹配包含大量ASCII控制字符(除了常见的\t, \n, \r)或非中日韩统一表意文字的字符

String regex = "[\\x00-\\x08\\x0b\\x0c\\x0e-\\x1f\\x7f]|[^\\u4e00-\\u9fa5\\u0030-\\u0039\\u0041-\\u005a\\u0061-\\u007a\\s\\p{Punct}]";

return Pattern.compile(regex).matcher(str).find();

}

public static void main(String[] args) {

String normalStr = "Hello, 你好 123!";

System.out.println("正常字符串判断结果: " + isMessyCodeByRegex(normalStr)); // false

String messyStr = "锟斤拷锟斤拷";

System.out.println("乱码字符串判断结果: " + isMessyCodeByRegex(messyStr)); // true

}

}

优点:

- 速度快,直接在字符串层面进行模式匹配。

缺点:

- 适用性窄:正则表达式很难覆盖所有乱码情况,容易产生误判,只能作为一种辅助手段。

第三方库(功能强大,一劳永逸)

对于复杂的项目,引入成熟的第三方库是明智之举。juniversalchardet(源自Mozilla的Universalchardet)是一个非常流行的字符集探测库,它能自动检测一段文本最可能的字符集。

Maven依赖:

<dependency>

<groupId>com.github.albfernandez juniversalchardet</groupId>

<artifactId>juniversalchardet</artifactId>

<version>2.4.0</version>

</dependency>

代码示例:

import org.mozilla.universalchardet.UniversalDetector;

import java.io.IOException;

import java.io.InputStream;

import java.nio.charset.Charset;

public class MessyCodeCheckerWithLibrary {

/**

* 方法四:使用juniversalchardet库检测字符集

* @param str 待检查的字符串

* @return 如果检测到的字符集与预期不符,则认为是乱码

*/

public static boolean isMessyCodeByLibrary(String str, String expectedCharset) {

if (str == null) {

return false;

}

byte[] bytes = str.getBytes(); // 默认使用JVM的默认字符集,最好明确指定,如getBytes(StandardCharsets.ISO_8859_1)

UniversalDetector detector = new UniversalDetector(null);

detector.handleData(bytes, 0, bytes.length);

detector.dataEnd();

String detectedCharset = detector.getDetectedCharset();

detector.reset();

// 如果检测到的字符集不为空,且与预期不符,则认为是乱码

// 注意:检测可能失败,返回null

return detectedCharset != null && !detectedCharset.equalsIgnoreCase(expectedCharset);

}

public static void main(String[] args) {

// 假设我们期望字符串是UTF-8

String expectedCharset = "UTF-8";

// 一个用GBK编码的字符串,但我们的期望是UTF-8

String gbkStr = "你好,世界"; // 假设这个字符串在内存中是GBK编码的字节被错误解析

// 注意:这个例子需要更复杂的场景来准确展示,因为Java String是Unicode。

// 更真实的场景是,你有一堆字节数据,不知道它是什么编码。

// 这里我们模拟一个场景:一个被错误解析的字符串

String byteStr = new String("你好,世界".getBytes(Charset.forName("GBK")), Charset.forName("ISO-8859-1"));

System.out.println("模拟乱码字符串判断结果: " + isMessyCodeByLibrary(byteStr, expectedCharset)); // 可能输出true

String utf8Str = "Hello, World!";

System.out.println("正常UTF-8字符串判断结果: " + isMessyCodeByLibrary(utf8Str, expectedCharset)); // false

}

}

优点:

- 功能强大:能自动探测未知编码,是处理未知来源文本的利器。

- 准确度高:基于成熟的算法,判断结果可靠。

缺点:

- 引入外部依赖:增加了项目的复杂度。

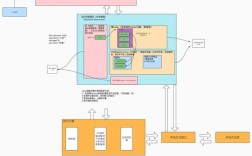

终极策略——结合多种方法

在实际项目中,没有一种方法是万能的,最稳妥的策略是结合多种方法,形成一个“乱码判断矩阵”。

逻辑流程:

- 优先探测:如果来源未知,先用

juniversalchardet探测字符集。 - 自洽性校验:如果来源已知(或探测后得到一个候选编码),用

CharsetDecoder方法进行严格的解码校验。 - 特征扫描:对于一些已知的、常见的乱码模式(如

"锟斤拷"),可以用正则表达式进行快速过滤。

这种组合拳的方式,可以最大程度地提高判断的准确性和鲁棒性。

第三部分:最佳实践与防乱码策略

判断乱码是“治标”,建立正确的编码规范才是“治本”。

-

统一编码标准:在项目开发中,强制所有环节统一使用UTF-8编码,包括:

- 源代码文件:IDE设置文件编码为UTF-8。

- JVM参数:启动JVM时加上

-Dfile.encoding=UTF-8(虽然JDK文档不推荐,但有时是必要的)。 - Web容器:Tomcat、Jetty等设置

URIEncoding="UTF-8"和useBodyEncodingForURI="true"。 - 数据库:数据库、表、连接、驱动都设置为UTF-8。

- 前端:HTML页面

<meta charset="UTF-8">,AJAX请求设置Content-Type: application/json; charset=utf-8。

-

显式指定编码:永远不要依赖系统的默认编码,在进行

String.getBytes()和new String()转换时,始终显式指定字符集。- 错误示范:

byte[] bytes = str.getBytes(); - 正确示范:

byte[] bytes = str.getBytes(StandardCharsets.UTF_8);

- 错误示范:

-

使用

InputStreamReader/OutputStreamWriter:在读写文件、网络流时,使用带字符集参数的InputStreamReader和OutputStreamWriter,而不是直接使用字节流。 -

处理HTTP请求/响应:确保Web框架正确处理了请求和响应的编码,Spring Boot等现代框架通常默认就处理得很好。

Java乱码问题虽老生常谈,但却是每个开发者必须跨越的坎,我们系统性地学习了5种判断字符串乱码的方法:

| 方法 | 原理 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

String方法 |

编码-解码-比较 | 直观简单 | 性能差,不绝对准确 | 快速原型验证,学习理解 |

CharsetDecoder |

严格解码校验 | 专业,可靠,性能好 | 代码稍复杂 | 生产环境推荐,已知编码的校验 |

| 正则表达式 | 模式匹配 | 速度快 | 适用性窄,易误判 | 特定乱码特征的辅助判断 |

| 第三方库 | 自动探测编码 | 功能强大,准确 | 引入外部依赖 | 处理未知来源的文本 |

| 组合策略 | 多方法融合 | 准确性最高,鲁棒性强 | 实现复杂 | 对准确性要求极高的核心业务 |

判断乱码是最后的防线,建立并遵守“UTF-8优先,显式指定”的编码规范,才是从根本上杜绝乱码问题的最佳实践,希望这篇文章能帮助你彻底告别“?”号噩梦,写出更健壮、更专业的Java代码!

#Java #乱码 #字符编码 #UTF-8 #编程技巧 #后端开发 #解决方案