核心对比一览表

| 特性维度 | Python 爬虫 | Java 爬虫 |

|---|---|---|

| 语法与易用性 | 语法简洁,上手快,像写伪代码,开发效率高。 | 语法严谨,结构化,需要编译,开发周期相对较长。 |

| 生态系统与库 | 极其丰富和强大。Requests + BeautifulSoup / Scrapy 是黄金组合,社区活跃。 |

同样强大,但更企业级。Jsoup (HTML), HttpClient (HTTP), Selenium (浏览器), WebMagic / Jsoup (框架)。 |

| 性能与并发 | 受限于GIL (全局解释器锁),多线程CPU密集型任务性能不佳,但异步IO (asyncio) 在I/O密集型任务上表现优异。 |

天生为高性能并发设计,JVM的JUC包、NIO模型、多线程处理能力非常强大,适合大规模、高并发的爬取任务。 |

| 项目维护性 | 小型项目快速迭代,大型项目依赖代码规范和架构设计。 | 天生适合大型、复杂、长期维护的项目,强类型、面向对象、工程化程度高。 |

| 反爬与处理 | 处理JS渲染页面依赖Selenium或Playwright,相对“重”,但配合Pyppeteer等工具也很方便。 |

处理JS渲染页面可以使用Selenium (Java版) 或 HtmlUnit,后者更轻量,性能更好。 |

| 部署与运行 | 解释型语言,部署简单,但启动速度慢。 | 编译型语言,启动快,内存占用相对较高,但性能稳定。 |

| 企业级应用 | 广泛使用,但在大型企业中,Java生态更成熟(如与Spring Boot集成)。 | 绝对的主流,很多大型互联网公司的核心爬虫系统都是基于Java构建的。 |

| 学习曲线 | 非常平缓,适合初学者和快速原型开发。 | 相对陡峭,需要理解JVM、面向对象、多线程等概念。 |

详细分析

语法与开发效率

-

Python (王者)

-

优势: Python的语法非常简洁、清晰,可读性极高,开发者可以专注于业务逻辑,而不是复杂的语法细节,用几行代码就能完成一个HTTP请求和HTML解析。

-

代码示例 (Python):

import requests from bs4 import BeautifulSoup url = 'http://example.com' response = requests.get(url) soup = BeautifulSoup(response.text, 'html.parser') title = soup.find('title').text print(title) -

对于快速验证想法、开发小型爬虫或个人项目,Python无与伦比。

-

-

Java (稳健)

-

优势: Java是强类型、面向对象的语言,代码结构严谨,IDE(如IntelliJ IDEA)的代码提示、重构、调试功能非常强大,适合构建大型、可维护、可扩展的系统。

-

劣势: 代码量通常比Python多,需要编写更多的“样板代码”(boilerplate code),开发初期速度较慢。

-

代码示例 (Java):

import org.jsoup.Jsoup; import org.jsoup.nodes.Document; import org.jsoup.nodes.Element; public class Crawler { public static void main(String[] args) throws Exception { String url = "http://example.com"; Document doc = Jsoup.connect(url).get(); Element title = doc.title(); System.out.println(title); } } -

适合对代码质量、可维护性和长期运行有高要求的企业级项目。

-

生态系统与库

-

Python (丰富且易用)

- HTTP请求:

Requests是事实标准,简单易用。 - HTML/XML解析:

BeautifulSoup和lxml非常强大,语法直观。 - 爬虫框架:

Scrapy是功能最全面的爬虫框架,支持分布式、数据管道、中间件等,是构建大型爬虫的利器。 - 浏览器自动化:

Selenium和Playwright(Python版) 用于处理动态加载的网页。 - 异步IO:

aiohttp+asyncio让Python在I/O密集型任务上也能实现高并发。

- HTTP请求:

-

Java (强大且企业化)

- HTTP请求:

Apache HttpClient是老牌经典,功能全面但配置稍复杂。OkHttp是更现代、更简洁的选择。 - HTML解析:

Jsoup是Java版的“BeautifulSoup”,非常流行和易用。 - 爬虫框架:

WebMagic是一个轻量级、可快速上手的爬虫框架,设计思想借鉴了Scrapy。Crawler4j也是一个不错的选择。 - 浏览器自动化:

Selenium有成熟的Java版本。HtmlUnit是一个“无头浏览器”,模拟浏览器行为,性能远超Selenium,适合处理复杂的JS。 - 并发:

java.util.concurrent(JUC) 包提供了丰富的并发工具类,CompletableFuture等让异步编程变得规范。

- HTTP请求:

性能与并发

这是两者最核心的区别之一。

-

Python (I/O密集型优秀,CPU密集型受限)

- 由于GIL的存在,Python的多个线程在同一时刻只能由一个线程执行,这使得Python在CPU密集型任务(如大量计算、数据压缩)上无法充分利用多核CPU。

- 爬虫主要是I/O密集型任务(等待网络请求、磁盘读写),在这种情况下,Python的异步IO模型 (

asyncio) 可以用单线程处理成千上万的并发连接,效率极高。 - 如果你的爬虫主要是抓取静态页面,Python的性能完全足够,如果涉及大量CPU计算,或者需要极高的并发连接数,Python会显得吃力。

-

Java (高并发王者)

- Java天生为并发而生,JVM的线程模型非常成熟,可以轻松创建和管理大量线程,其NIO (New I/O) 模型为高并发网络编程提供了强大的支持。

- Java在处理CPU密集型任务时,可以充分利用多核CPU。

- 对于需要构建分布式爬虫集群、每秒处理成千上万个请求、或者需要7x24小时稳定运行的高性能爬虫系统,Java是更可靠的选择。

项目维护性

- Python: 代码简洁,但也意味着代码的“自我约束”更重要,如果没有良好的编码规范和项目结构,大型Python项目可能会变得混乱,难以维护。

- Java: 强类型系统、面向对象的设计和成熟的工程化工具(如Maven/Gradle, Spring Boot)使得Java天生适合构建大型、复杂、需要长期维护和多人协作的项目,代码的可读性和可预测性更高。

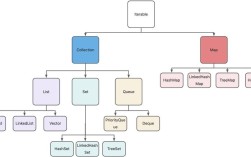

如何选择?一张图帮你决定

graph TD

A[选择爬虫语言] --> B{项目规模与复杂度?};

B -- 小型/个人/快速原型 --> C[Python];

B -- 大型/企业级/长期维护 --> D[Java];

A --> E{主要任务类型?};

E -- I/O密集型 (大量请求) --> F{并发模型};

F -- 单线程异步 (asyncio) --> C;

F -- 多线程/分布式 --> D;

E -- CPU密集型 (复杂计算) --> D;

A --> G{团队技能?};

G -- Python背景/快速上手 --> C;

G -- Java背景/企业级开发 --> D;

A --> H{反爬与JS处理?};

H -- 静态页面/简单JS --> C;

H -- 复杂JS渲染/需要高性能 --> D;

| Python 爬虫 | Java 爬虫 | |

|---|---|---|

| 核心优势 | 开发效率高、生态丰富、上手快 | 性能强、并发好、工程化程度高、适合大型项目 |

| 形象比喻 | 瑞士军刀:灵活、多功能,适合各种日常和复杂任务,但需要使用者技巧。 | 重型挖掘机:力量强大、结构稳定,适合大规模、高强度的工程作业。 |

| 适用场景 | - 个人学习和小型项目 - 快速验证想法和原型 - 数据分析和科学计算结合 - 中小型网站爬取 |

- 大型企业级爬虫系统 - 需要高并发、高可用的分布式爬虫 - 复杂的网站(需要处理大量JS和反爬) - 长期运行和维护的核心业务系统 |

最终建议:

- 如果你是初学者、学生,或者想快速完成一个爬虫任务,毫不犹豫地选择Python,它能让你在最短的时间内看到成果,并快速学习爬虫的核心思想。

- 如果你是在企业工作,需要构建一个稳定、高效、可扩展的爬虫系统,或者你的爬虫任务量巨大,对性能要求苛刻,Java是更稳妥、更强大的选择,它的工程化和并发能力能更好地支撑业务的长期发展。

两者都是非常优秀的工具,没有绝对的优劣,只有是否适合当前场景之分,很多开发者甚至会两者都使用,用Python做快速探索和数据分析,用Java构建生产环境的核心服务。