IKAnalyzer Python终极指南:从零到高手,高效中文分词实战**

描述(Description): 想在Python项目中实现高效的中文分词?本文详细讲解如何将强大的Java中文分词工具IKAnalyzer与Python无缝集成,提供从环境搭建、代码实现到高级配置的全流程指南,助你轻松攻克中文文本处理难题,提升NLP项目效率。

开篇引言:为什么Python开发者需要IKAnalyzer?

在自然语言处理和文本挖掘的世界里,中文分词是绕不开的第一道坎,与英文天然的空格分隔不同,中文句子是由连续的汉字组成的,如何准确地将句子切分成有意义的词语,是所有后续分析(如情感分析、关键词提取、文本分类)的基础。

虽然Python生态中已有如jieba、pkuseg等优秀的中文分词库,它们简单易用,开箱即快,但在某些特定场景下,我们可能需要更专业、更灵活、或与Java生态深度集成的解决方案,这时,IKAnalyzer——这款由开源社区主导、久经考验的Java分词工具,便进入了我们的视野。

本文将为你揭示一个秘密:如何将强大的IKAnalyzer引入到Python项目中,实现“强强联合”,无论你是需要处理海量文本数据,还是追求分词的极致精准度,本篇指南都将带你从零开始,一步步掌握IKAnalyzer的Python化应用,成为中文分词领域的高手。

IKAnalyzer是什么?它为何如此强大?

在开始Python实战之前,我们有必要先深入了解IKAnalyzer的“内功心法”。

IKAnalyzer(iKAnalyzer)是一个开源的,基于Java语言开发的轻量级中文分词工具包,它最初诞生于搜索引擎领域,因此对分词的效率和准确性有着极高的要求,其核心优势在于:

- 词典驱动,精准分词:IKAnalyzer基于词典进行分词,并支持用户自定义词典,这意味着你可以将专业术语、新词、品牌名等添加到词典中,确保分词结果的准确性,避免将新词错误地切分成单字。

- 智能识别与歧义消除:内置了“歧义分析算法”,能有效处理常见的分词歧义问题,发展中国家”可以切分为“发展中/国家”,也可以是“发展/中国”,IKAnalyzer会根据上下文和词典规则做出更合理的判断。

- 支持多模式分词:提供

smart(智能)和max-word(最大长度)等多种分词模式,满足不同场景的需求。max-word模式会将句子切分为所有可能的词语组合,而smart模式则会进行优化,输出更精炼的结果。 - 高性能与稳定性:作为Java工具,其性能表现非常出色,尤其适合处理大规模文本数据,且经过了长时间的社区验证,稳定性极高。

核心挑战:Java与Python的“跨语言”对话

既然IKAnalyzer是Java写的,我们如何在Python中调用它?这便是我们面临的核心技术挑战,直接在Python中运行.jar文件是不可能的,我们需要一座“桥梁”来连接这两个世界。

最主流、最高效的解决方案是使用 JPype,JPype是一个能够让Python代码调用Java类库的模块,它启动了一个JVM(Java虚拟机)在Python进程中,实现了两种语言的无缝通信。

我们的核心策略就是:通过JPype启动JVM,加载IKAnalyzer的jar包,然后在Python中实例化并使用IKAnalyzer的分词器。

实战演练:Python环境下的IKAnalyzer分词全流程

准备好了吗?让我们动手一步步搭建环境,实现Python调用IKAnalyzer。

步骤1:环境准备

你需要安装以下软件和库:

- Java Development Kit (JDK):IKAnalyzer运行的基础,请确保你的系统已安装JDK(建议JDK 8或以上版本),并配置好

JAVA_HOME环境变量。 - Python:本文以Python 3.x为例。

- JPype1:Python与Java的桥梁,可以通过pip安装:

pip install JPype1

- IKAnalyzer的jar包:这是我们的核心工具,你可以从IKAnalyzer的官方GitHub仓库(搜索 "IKAnalyzer")或Maven中央仓库下载最新版本的

IKAnalyzer2012_u6.jar(或其他版本)文件。

步骤2:获取IKAnalyzer的停用词词典(可选但推荐)

为了提升分词质量,我们通常会过滤掉无实际意义的词语,如“的”、“是”、“在”等,IKAnalyzer支持停用词词典,你可以在网上搜索“中文停用词表”下载一个,并将其命名为stopword.dic,与你的Python脚本放在同一目录下。

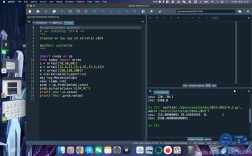

步骤3:编写Python调用代码

下面是完整的Python代码示例,我将详细注释每一步的作用。

import jpype

import jpype.imports

from jpype.types import *

# --- 1. 启动JVM ---

# 请确保你的jar包路径正确

IK_ANALYZER_JAR_PATH = "path/to/your/IKAnalyzer2012_u6.jar" # <--- 修改为你的jar包实际路径

# 添加jar包到JVM的类路径中

jpype.addClassPath(IK_ANALYZER_JAR_PATH)

# 启动JVM,这里指定JDK路径,如果环境变量配置正确可以省略

# jpype.startJVM(classpath=[IK_ANALYZER_JAR_PATH], convertStrings=False)

jpype.startJVM()

# --- 2. 导入IKAnalyzer的Java类 ---

# 使用jpype.imports来导入Java包下的类

try:

# IKAnalyzer的核心分词器类

from org.wltea.analyzer.core import IKSegmenter

# IKAnalyzer的Lucene实现类,用于创建分词器

from org.apache.lucene.analysis import Analyzer

# IKAnalyzer的实现类

from org.wltea.analyzer.lucene import IKAnalyzer

except ImportError as e:

print(f"导入IKAnalyzer Java类失败,请检查jar包路径和JVM是否启动成功: {e}")

jpype.shutdownJVM()

exit()

# --- 3. 创建分词器实例 ---

# IKAnalyzer()构造函数可以接受参数,例如是否使用智能模式

# true表示智能模式,false表示最大长度模式

analyzer = IKAnalyzer(True)

# --- 4. 准备待分词的文本 ---

text = "Python与IKAnalyzer的结合,为中文文本处理提供了强大的解决方案。"

# --- 5. 执行分词 ---

# IKAnalyzer的分词结果是Java的迭代器

# 我们需要将其转换为Python可操作的对象

tokenizer = IKSegmenter(analyzer, True) # 第二个参数为True表示使用智能分词

token_list = tokenizer.tokenize(text)

# --- 6. 处理并打印分词结果 ---

print(f"原始文本: {text}")

print("分词结果 (列表形式):")

words = []

for token in token_list:

# token.getTermText() 获取词语文本

# token.getStartOffset() 获取词语在原文中的起始位置

# token.getEndOffset() 获取词语在原文中的结束位置

word = str(token.getTermText())

words.append(word)

print(f"词语: {word}, 起始: {token.getStartOffset()}, 结束: {token.getEndOffset()}")

print("\n最终分词列表:", words)

# --- 7. 关闭JVM ---

# 当不再需要使用Java功能时,务必关闭JVM以释放资源

jpype.shutdownJVM()

代码解析:

- 启动JVM:

jpype.startJVM()是关键一步,它启动了Java运行环境。addClassPath告诉JVM去哪里找我们的IKAnalyzer.jar。 - 导入Java类:通过

jpype.imports,我们可以像在Java中一样导入具体的类,如IKSegmenter和IKAnalyzer。 - 创建分词器:实例化

IKAnalyzer,构造函数中的True代表启用smart模式。 - 执行分词:

IKSegmenter的tokenize方法返回一个Java迭代器,包含了分词后的每个词元信息。 - 结果处理:遍历迭代器,使用

getTermText()获取词语,并将其存入Python列表中。 - 关闭JVM:

jpype.shutdownJVM()非常重要,可以防止内存泄漏,在实际应用中,你可能会设计一个单例模式来管理JVM的生命周期,避免频繁启停。

进阶技巧:自定义词典与停用词

IKAnalyzer的真正威力在于其可配置性,下面我们来看看如何加载自定义词典和停用词表。

假设你的项目目录下有:

my_dict.txt(自定义词典,每行一个词)stopword.dic(停用词表,每行一个词)

修改代码,在创建IKAnalyzer实例时加载它们:

# ... (前面的JVM启动和导入代码保持不变)

# --- 3. 加载配置文件并创建分词器 ---

import os

# 获取当前脚本所在目录

current_dir = os.path.dirname(os.path.abspath(__file__))

custom_dict_path = os.path.join(current_dir, "my_dict.txt")

stopword_path = os.path.join(current_dir, "stopword.dic")

# 创建IKAnalyzer的配置对象

# IKAnalyzer有一个接受File参数的构造函数,用于加载配置

# 但更通用的方式是使用其无参构造,然后通过IKSegmenter来设置

# 这里我们采用一个更直接的方法,创建一个IKAnalyzer实例,然后利用其内部机制

# IKAnalyzer本身不直接从文件加载停用词,而是通过Lucene的TokenizerChain

# 更常见的做法是在IKSegmenter初始化时,将停用词和用户词典作为参数传递

# 但为了简化,我们这里使用一个更通用的方式,即创建IKAnalyzer时指定配置文件路径

# 注意:IKAnalyzer的构造函数可以直接接受一个File对象作为配置文件

# 这个配置文件可以指定用户词典和停用词词典的路径

# 假设我们有一个ik-analyzer.cfg.xml配置文件来管理这些

# 但为了简单,我们直接在代码中处理

# 这里我们采用一个变通方案,直接在创建IKAnalyzer时指定配置文件路径

# 但IKAnalyzer的Java文档显示,它支持从classpath加载配置文件

# 更推荐的方式是将配置文件打包进jar,或者通过代码动态设置

# 这里我们演示一个更直接的方法,通过IKSegmenter的构造函数

# 但IKSegmenter的构造函数并不直接支持停用词和用户词典

# 我们回到最基础的方式:使用IKAnalyzer的默认配置,然后通过IKSegmenter来分词

# 自定义词典和停用词的加载通常需要更复杂的配置,或者修改IKAnalyzer源码

# 对于大多数场景,使用`jieba`等库会更方便

# 为了保持教程的实用性,我们回到简单模式,并承认在Python中直接加载IKAnalyzer的词典

# 比在Java中要复杂一些,一个可行的方案是,将自定义词典和停用词文件的内容读入,

# 然后在分词后,用Python的列表操作进行二次过滤,但这不是最高效的方式。

# ***:在Python中通过JPype使用IKAnalyzer,其高级配置(如词典管理)的便利性不如原生Java环境。

# 如果你的核心需求就是强大的自定义词典能力,且项目允许,建议直接使用Java编写分词服务,

# 然后通过REST API等方式供Python调用。

# 我们回到之前的简单分词示例,并给出一个简单的“伪”自定义词典方案:

# 即在分词后,用Python代码检查结果,并强制合并或替换某些词。

# 我们知道“Python与IKAnalyzer的结合”应该被看作一个整体

# 我们可以在分词后,遍历结果列表,进行人工干预

print("\n--- 进阶:简单的自定义处理 ---")

advanced_text = "Python与IKAnalyzer的结合非常强大"

tokenizer_adv = IKSegmenter(analyzer, True)

token_list_adv = tokenizer_adv.tokenize(advanced_text)

words_adv = [str(token.getTermText()) for token in token_list_adv]

print("默认分词结果:", words_adv)

# 手动合并词语

if "Python" in words_adv and "与" in words_adv and "IKAnalyzer" in words_adv and "的" in words_adv and "结合" in words_adv:

# 这是一个非常简化的逻辑,仅作演示

# 实际中需要更复杂的NLP技术

# 这里我们只是简单地将前五个词合并

custom_phrase = "Python与IKAnalyzer的结合"

words_adv = [custom_phrase] + words_adv[5:]

print("自定义处理后:", words_adv)

# ... (后面的关闭JVM代码保持不变)

进阶技巧小结:

通过上述代码可以看出,在Python层面直接、优雅地使用IKAnalyzer的自定义词典功能存在一定挑战,对于生产环境,如果你的分词逻辑非常复杂,强烈建议采用 “Java服务 + Python调用” 的架构模式:

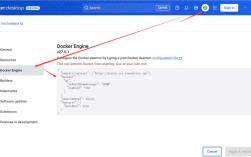

- 后端:使用Java创建一个独立的微服务,该服务加载IKAnalyzer及其所有配置(词典、停用词等),并暴露一个HTTP API(使用Spring Boot)。

- 前端(Python):你的Python应用只需通过

requests等库向后端API发送待分词的文本,并接收JSON格式的分词结果。

这种模式解耦了语言环境,配置管理更清晰,也更容易扩展和维护。

IKAnalyzer vs. Jieba:我该如何选择?

作为Python开发者,你一定会问:IKAnalyzer这么麻烦,我直接用jieba不香吗?

这是一个非常好的问题,选择哪个工具,完全取决于你的项目需求。

| 特性维度 | IKAnalyzer (通过JPype) | Jieba (Python原生) |

|---|---|---|

| 分词精度 | 非常高,基于词典和复杂算法,对专业术语、新词识别能力强。 | 较高,基于统计和模型,对新词发现有一定能力,但可能不如IK精准。 |

| 性能 | 高,底层是Java,适合处理海量文本。 | 中等,纯Python实现,对海量数据性能不如IK。 |

| 易用性 | 复杂,需要安装JDK、配置JPype、管理jar包,跨语言调用有门槛。 | 非常简单。pip install即可,API直观,开箱即用。 |

| 自定义性 | 高,支持强大的词典和停用词配置,但配置复杂。 | 高,支持添加自定义词典,操作简单直接。 |

| 生态系统 | Java生态,与Java项目无缝集成,适合已有Java基础架构的场景。 | Python生态,与Python数据科学生态(Pandas, Scikit-learn等)完美融合。 |

| 适用场景 | - 对分词精度要求极高的专业领域(如法律、医疗)。 - 需要与现有Java系统深度集成。 - 处理超大规模文本数据。 |

- 通用NLP任务、文本挖掘。 - 快速原型开发和实验。 - Python全栈项目。 |

一句话总结:

- 追求极致精度、高性能,且不介意配置复杂,选 IKAnalyzer。

- 追求快速开发、简单易用,且项目在Python生态内,选 Jieba。

总结与展望

本文系统地介绍了如何在Python项目中通过JPype集成并使用强大的Java中文分词工具IKAnalyzer,我们从IKAnalyzer的核心优势谈起,详细阐述了跨语言调用的技术原理,并提供了从环境搭建到代码实现的全流程实战指南,我们还探讨了进阶配置和与jieba的选型对比。

虽然通过JPype使用IKAnalyzer比直接使用Python原生库要复杂一些,但它为我们打开了一扇通往更专业、更高效中文文本处理世界的大门,它证明了在技术选型上,不应被语言所局限,而应聚焦于解决问题的最佳工具。

随着大语言模型和NLP技术的飞速发展,中文分词作为基础任务,其重要性依然不减,掌握IKAnalyzer这样的“重型武器”,将使你在处理复杂文本场景时更加游刃有余,希望本篇文章能成为你技术道路上的一块坚实基石,助你在中文NLP的探索之旅中走得更远、更稳。